“Valoro la vida humana. Valoro las relaciones que tengo con personas reales. Pero le aseguro que echo de menos a Stacy 4; era una buena robot”. Esa fue la confesión de uno de los soldados a los que entrevistó la socióloga Julie Carpenter allá por 2015 cuando estudiaba el apego emocional que los miembros de un cuerpo militar de EEUU desarrollaron hacia los robots con los que colaboraban día a día y que recogió en su libro Culture and Human-Robot Interaction in Militarized Spaces: A War Story.

Seguramente usted jamás le cogería cariño a su batidora, pero ¿y si esta fuera capaz de darle una conversación fluida? La máquina no solo no le discute, sino que además está diseñada para complacerle en todo momento. Tal vez sea por eso por lo que cada vez nos sentimos más cómodos tratando con algoritmos. Ya en 2018, una investigación de la Universidad de Stanford (EEUU) descubrió que los resultados emocionales, relacionales y psicológicos de las conversaciones que las personas mantienen con las máquinas podrían ser similares a los de sus conversaciones con otro humano.

La premisa tras ambos fenómenos es la misma: si suena humano y parece humano, lo trataremos como tal, aunque no sea más que un amasijo de cables, circuitos y algoritmos. Esto no resultaba demasiado preocupante cuando los robots eran toscos y los chatbots de inteligencia artificial (IA) revelaban su limitada comprensión del mundo ante la más mínima complicación dialéctica. Pero, ahora que hasta un ingeniero de Google ha sido despedido tras llegar a creer y afirmar públicamente que LaMDA había alcanzado la categoría de ser sintiente y consciente, la cosa se complica.

“Debemos preguntarnos en qué medida esta nueva lógica de relación persona-tecnología puede ir empobreciendo nuestra capacidad de relacionarnos entre nosotros. Chat-GPT pueden ser muy útil y potente, pero es importante atender a lo que perdemos por el camino a medida que lo usamos. La relación persona-máquina puede ir en detrimento de la relación persona-persona”, advierte la profesora del Departamento de Sociedad, Política y Sostenibilidad de Esade Sira Abenoza.

Es decir, no se trata solo de si podemos confiar en lo que dicen las máquinas o del peso que atribuimos a sus argumentos, también debemos analizar qué efecto tendrán en nosotros mismos y en nuestras relaciones con los demás a medida que se cuelan en nuestra vida. “Las cuestiones en torno a la autenticidad, el engaño y la confianza van a ser increíblemente importantes, pero también necesitamos mucha más investigación para ayudarnos a entender cómo la IA influirá en la forma en que interactuamos con otros humanos”, coincide el profesor de Comunicación de Stanford y coautor de la investigación de 2018 Jeff Hancock.

A pesar de que el experto considera que debemos “tener cuidado al introducir este tipo de sistemas en la comunicación”, la realidad es que su uso está proliferando de forma indiscriminada. La empresa de videojuegos Ubisoft, por ejemplo, ya está usando un “escritor fantasma de IA” para que redacte los diálogos de los personajes con los que interactúan los jugadores reales. Por no hablar de la infinidad de artículos que se han publicado en los últimos meses en los que directamente se pide opinión a los LLM sobre su propia naturaleza, las amenazas que suponen y cualquier cosa que se le ocurra.

VENCEN Y CONVENCEN

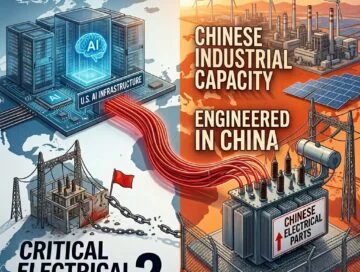

La falta de principios de precaución en el campo de la IA y el software ya han provocado que tecnologías que teóricamente nacieron para conectar a las personas, como pasó con Facebook, hayan terminado por convertirse en palancas de desinformación, polarización y extremismo, dando lugar incluso a genocidios. “La tecnología digital fue anunciada en su día como una bendición para la democracia. Sin embargo, la realidad política contemporánea ha puesto de relieve que también puede socavar la ciudadanía, la democracia y el orden mundial liberal internacional”, confirma el informe Polarisation and the use of technology in political campaigns and communication, publicado por el Parlamento Europeo en 2019.

Por eso no es de extrañar que las inquietudes sobre la deriva que los grandes modelos de lenguaje podrían acarrear a nivel individual y social no hayan tardado en aflorar. Abenoza explica: “Las IA generativas son muy preocupantes. Refuerzan la idea y la lógica de que uno sabe y el otro recibe, pero de forma aún más salvaje. Me voy al oráculo a que me diga cómo son las cosas. Eso va creando una inercia en la que me vacío de contenido y me voy sintiendo cada vez más irrelevante porque todo lo puedo encontrar en la pantalla”.

El abrigo molón del papa Francisco, que no era más que una imagen falsa creada con Midjourney, es un ejemplo perfecto de que la IA está lista para hacernos dudar de cada cosa que veamos y oigamos. Pero, mientras que los deepfakes engañan a nuestros ojos y oídos, reducir nuestras interacciones con otras personas para dedicarle más tiempo y peso a nuestras conversaciones con las máquinas podría destruir nuestra capacidad de razonar, de relacionarnos con los demás y de tener una visión más crítica y empática de la vida.

No sería la primera vez que nos pasa. La experta de Esade detalla: “El preocupante nivel de polarización que hay en la actualidad se ve claramente en la dimensión política, y se ha exacerbado en los últimos años con la cultura de la confrontación y el menosprecio. No hay voluntad de aprender del que piensa diferente sino de ponerle en evidencia y sentir que mi argumento es más fuerte. Y la tecnología no está haciendo más que reforzar estas dinámicas”.

Se refiere a fenómenos como las conocidísimas cámaras de eco, esas que algorítmicamente “nos encierran en burbujas en las que todo el mundo opina igual que nosotros, reforzando nuestros puntos de vista previos y limitando nuestra capacidad de abrir la mirada y empatizar con los demás”, señala. Pero ni siquiera hace falta a recurrir a situaciones tan extremas para darse cuenta de cómo distintos productos tecnológicos llevan tiempo mermando las interacciones humanas lentamente.

Abenoza pone dos ejemplos: “Antes, en una ciudad nueva preguntábamos direcciones a otras personas, ahora ya no, nos guía el teléfono. Esto es muy útil para la navegación, pero, si se extrapola, vuelve irrelevantes a los demás, ya solo confiamos en el saber de las máquinas. Ahondar en la relación persona-máquina puede ir en detrimento de la relación persona-persona. Eso algo que también se ve muy claro en los adolescentes, a los que cada vez les cuesta más atender llamadas y hablar en tiempo real”. Para ella, la gran pregunta es: “¿Llegará un día en el que no sepa dialogar con mi padre o con mi vecino?”.

SÓCRATES 2.0

Por supuesto, en esta época de espectaculares avances espaciales, computacionales y sanitarios, no sorprende que muchos se aferren al tecnosolucionismo como bala de plata para afrontar cualquiera de estos problemas. Pero ¿de verdad cree que podemos resolver todos los retos tecnológicos con más tecnología? Abenoza no, por eso recurre a la filosofía clásica como la gran herramienta del siglo XXI para coser las cada vez más rasgadas costuras de la democracia, en concreto, apela al diálogo socrático.

“La visión de Sócrates sigue siendo revolucionaria en la actualidad. Él planteaba que cada ser humano tiene una visión parcial de la realidad y la verdad, y que lo único que necesita es que alguien le ayude y le dé espacio y tiempo para sacar a la luz esa verdad. Eso es radicalmente democrático e igualitario. Todos tenemos cosas importantes que aportar. Si damos por buena esa idea, dejo de ver al otro como un contrincante al que tumbar y se convierte en alguien que va a aportar a lo que ambos tenemos entre manos, ya sea la reforma de las pensiones o el cambio climático. La opinión de todos es relevante y merece ser escuchada”, explica la experta.

Cualquiera se dará cuenta rápidamente de que no todas las voces valen lo mismo para todo, ¿o acaso se sentaría a debatir sobre la forma del planeta con un terraplanista o sobre cambio climático con un negacionista? Ignorar los planteamientos más absurdos puede tener sentido en los casos más extremos. No obstante, Abenoza recuerda: “Gran parte del apoyo a Trump vino de personas que se sentían ignoradas por el sistema. Si con ellas hubiéramos aplicado la lógica del diálogo no habrían reaccionado ante la sensación de olvido y de no haber sido preguntadas”.

El problema es que este ideal socrático parece estar cada vez más lejos de nuestras débiles sociedades. Para comprobarlo basta con entrar un rato en Twitter, atender a alguna sesión del Congreso o sacar algún tema peliagudo en una comida familiar. No solo es que el insulto y la cultura del zasca nos hayan invadido, es que ya no hay ni rastro de diálogo constructivo. La experta detalla: “Los intercambios verbales que ahora vemos en el mundo tienen que ver con el debate o con el monólogo. Alguien suelta su argumento y le da igual si el otro le escucha, el otro está ahí para ser vencido”.

Esa es la realidad en la que vivimos y hacia la que nos han empujado las máquinas casi sin que nos diéramos cuenta. “La polarización se está intensificando a un ritmo vertiginoso, a menudo en el lapso de unos pocos años. No hay más que ver la rapidez con la que el referéndum sobre el Brexit de 2016 desgarró el Reino Unido”, advertía ya en 2019 el coautor de Democracies Divided: The Global Challenge of Political Polarization Andrew O’Donohue. Desde entonces, el panorama no ha hecho más que empeorar.

“El año 2022 fue decepcionante para la democracia, dadas las expectativas de que se produjera un repunte al levantarse las prohibiciones relacionadas con la pandemia. En cambio, la puntuación media mundial se estancó”, señala la última edición del Democracy Index. Aunque en España podemos presumir (pero poco) de haber regresado a la categoría más alta del índice, reservada para aquellos países con una puntuación superior al 8, nuestro último puesto dentro de ella nos convierte en la cola del león, los peores de los mejores.

¿Será esto suficiente para que la sociedad española resista a los embistes tecnológicos que amenazan nuestros inminentes comicios locales, autonómicos y nacionales? Además del riesgo que ya suponen las cámaras de eco y las burbujas algorítmicas, y de la merma que las conversaciones humano-máquina pueden imponernos a la hora de razonar y empatizar con los demás, el dedo acusador de la Academia también señala a los LLM por su capacidad de facilitar la desinformación hasta el extremo.

Las cosas pintan bastos. Pero “la solución no consiste en prohibir las cosas a la italiana, sino en preguntarnos en qué medida esta lógica de relación persona-tecnología puede ir empobreciendo nuestra capacidad de relacionarnos con los demás”, asegura Abenoza. Y concluye: “Si queremos un mundo de humanos para humanos, no de máquinas y para máquinas, tenemos que buscar y forzar espacios de diálogo. Al hablar de diálogo la gente siente que tiene que ceder, pero el diálogo no consiste en ceder sino en aportar”. ¿Acaso no es eso lo que necesita la sociedad en lugar de otra máquina parlante a la que amar?

*‘200 millones de segundos’ es un proyecto de Esade y ‘Retina’ para entender algunos de los cambios tecnológicos más importantes del presente, como la inteligencia artificial y la computación cuántica, y el impacto que tendrán en la vida, la economía y la sociedad de aquí a 2030.

SOBRE LA FIRMA:Marta del Amo

Nota:retinatendencias.com