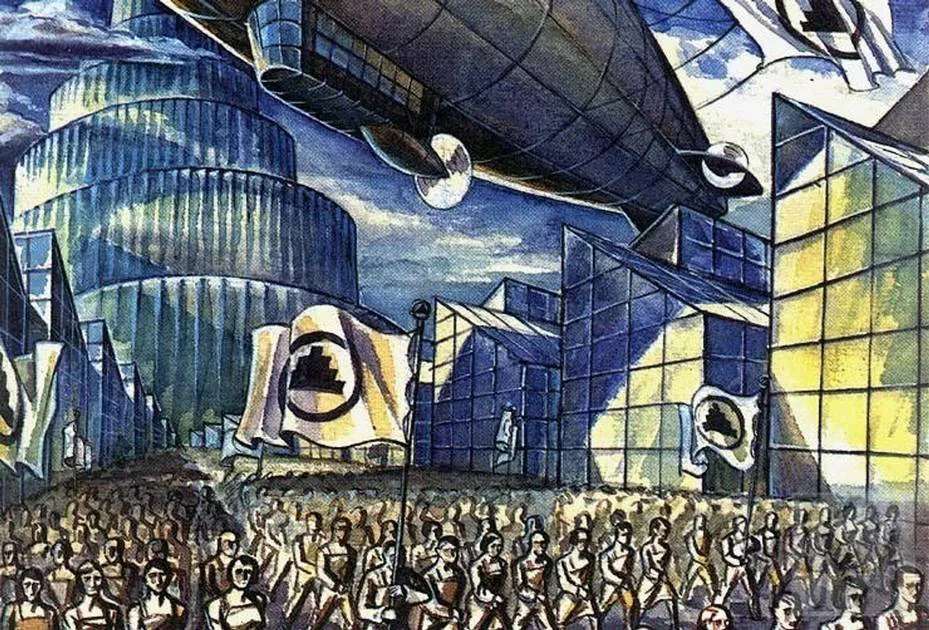

Así como las estadísticas de accidentes muestran que los seres humanos no somos buenos conduciendo automóviles, la frustración que muchas personas sienten frente a la gestión pública y la representación política parece un indicador de que tampoco somos excelentes gobernando. Considerando esta persistente ineficiencia, y sabiendo que las inteligencias artificiales pueden intervenir tanto en el oikos como en la polis, podemos plantearnos, en un ejercicio de curiosidad, las siguientes preguntas: ¿podrían mejorar las instituciones de un gobierno representativo si delegáramos algunos elementos de la gestión a una IA? ¿Tomarían mejores decisiones en política pública? La respuesta espontánea de la mayoría de la gente es que no. Pero antes de cerrar la cuestión rotundamente sigamos indagando.

Cuando elegimos a un diputado o un senador, lo hacemos pensando que tomará decisiones similares a las que nosotros tomaríamos. Es la esencia de la democracia representativa. Supongamos que se miden exhaustivamente las decisiones que toma nuestro senador electo y se comparan con las que toma un programa que ha estudiado nuestras preferencias. Y supongamos también que ese programa representa nuestra visión política de manera más precisa que el senador humano. Es decir, que en cientos de problemas diversos, la decisión que toma coincide con la que nosotros querríamos, mientras que esa coincidencia es muchísimo menor con la persona que votamos. ¿Estaríamos de acuerdo en delegar nuestro voto en ese programa que nos representa mejor, o hay temas que no pueden dejarse en manos de las máquinas?

El problema evidente de dar entrada a una IA en la función pública y el ejercicio del gobierno es, una vez más, la enorme dificultad de definir la función de valor que guíe sus decisiones. Podrán ser excelentes en llegar a la meta que les fijemos, pero ¿cuál será esa meta? La barrera esencial es lo variada y ecléctica que puede ser la definición de “bien común”. Desde una visión de derecha, probablemente la prioridad sea garantizar la propiedad privada, y para una visión más de izquierda, generar una sociedad con menos desigualdad. Del mismo modo que con el ejemplo de los automóviles egoístas y altruistas, habrá algoritmos de derecha, de centro y de izquierda, y múltiples variantes dentro de cada espacio ideológico. Probablemente, las máquinas empiecen a jugar un rol creciente en la toma de decisiones de política pública, pero no podremos librarnos de decidir qué idea del bien común respaldamos y qué meta preferimos priorizar.

Antes de enfrentarnos a esa encrucijada nos encontraremos con un problema más inmediato. Con el escándalo de Cambridge Analytica en 2018, descubrimos que es posible manipular el voto para influir en el resultado de elecciones. Ya en ese momento, la proliferación de noticias falsas diseñadas para viralizarse en las redes era un problema que no logramos solucionar. Y podemos imaginar que el problema aumentará enormemente en los años venideros ahora que, además, se podrán crear videos falsos en los que una persona, con su cara y con su voz, diga de manera sumamente realista cosas que jamás ha dicho. En el mundo de las IA generativas, las noticias falsas pueden ser mucho más sutiles y peligrosas. Una campaña política podrá también, usando deepfakes y clonación de voz, dirigir mensajes personalizados, diseñados a medida según las preferencias y vulnerabilidades de cada elector. El político ya no necesitará dar un mensaje para el votante promedio, sino que podrá decirle a cada uno lo que quiere escuchar. El que tenga acceso a nuestros datos tendrá también la llave para manipular, con bastante facilidad, nuestro voto.

El historiador y filósofo israelí Yuval Noah Harari sostuvo recientemente que la IA representa un peligro para el sistema democrático tal y como lo conocemos: “Esto es especialmente una amenaza para las democracias más que para los regímenes autoritarios porque las democracias dependen de la conversación pública. La democracia básicamente es conversación. Gente hablando entre sí. Si la IA se hace cargo de la conversación, la democracia ha terminado”.

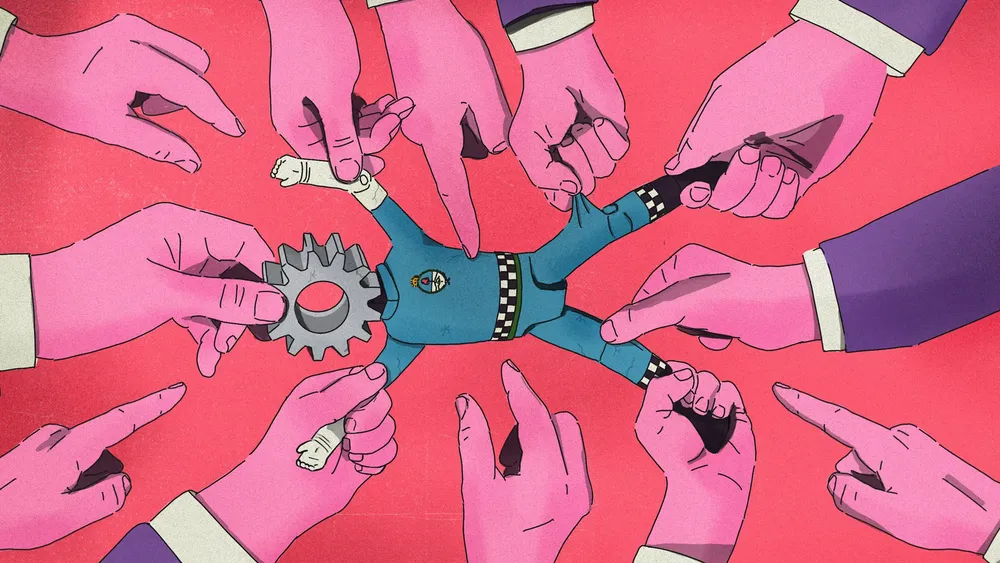

La conversación es la fábrica de ideas, es el lugar en el que construimos opiniones y creencias, en el que definimos lo que hacemos y lo que no, lo que nos parece bien o mal y en quien depositamos nuestra confianza. La genuina libertad de establecer cada uno de estos elementos sin manipulaciones ni interferencias está en el corazón de casi todas las nociones de república o de democracia representativa. Es la esencia de la polis. Y la IA conversacional, al servicio de intereses particulares o propios, tiene el potencial de inmiscuirse en este espacio de conversación pública, y así ponerla en jaque. Si intuimos que estas tecnologías podrían erosionar las bases mismas del sistema democrático, resulta inevitable preguntarnos: ¿es aceptable el uso de IA para manipular ideologías o para dirigir el debate público? Y si no lo fuese, ¿será posible imponer regulaciones que limiten los malos usos?

Aquí aparece otro gran desafío. Incluso si entendemos que es necesario introducir regulaciones para proteger las instituciones democráticas, no está claro quién tiene la atribución para hacerlo. Por un lado, porque en cada país son justamente los actores del sistema político los potenciales beneficiarios de esos mecanismos manipulativos. Por otro, porque la interferencia puede impulsarse y ejecutarse de acuerdo con los intereses de grupos o naciones extranjeros. La clave es que la IA no reconoce las fronteras tradicionales. Ni las de los gobiernos, ni las de los países.

Humanos contra humanos

La Segunda Guerra Mundial precipitó el desarrollo de la IA y de la tecnología nuclear. Pero después del conflicto, ambas tecnologías siguieron trayectorias muy diferentes. Mientras que la IA quedó relegada a una curiosidad académica, el poderío del arsenal atómico se convirtió en la clave para el balance geopolítico del mundo de las siguientes ocho décadas.

Es probable que el objetivo principal de lanzar las bombas sobre Hiroshima y Nagasaki no fuera solamente la destrucción de esas dos ciudades, y la muerte de unas doscientas cincuenta mil personas, sino mostrar al mundo que Estados Unidos disponía de un arma nueva que terminaba de inclinar por completo el balance de fuerzas en aquel conflicto. En ese momento, un grupo de científicos involucrados en el programa de desarrollo nuclear de Estados Unidos decidieron, de forma deliberada, compartir esta información con la Unión Soviética. Su objetivo era acelerar el programa análogo soviético para que esta no quedase a merced de su circunstancial aliado, que era en realidad su nuevo y mayor rival geopolítico. Cuatro años después, en 1949, la URSS detonó, en una prueba en Kazajistán, su primera arma nuclear, dando comienzo a la Guerra Fría. Durante esta etapa, que duró cuarenta años, se mantuvo entre las dos potencias un equilibrio tan tenso como precario.

“Si la IA se hace cargo de la conversación, la democracia ha terminado”.

Con la caída del bloque soviético y la proliferación nuclear, se inició un nuevo período en el que el mundo pasó de una puja entre dos poderes a una clara hegemonía estadounidense. De acuerdo con un índice multifactorial construido por la consultora McKinsey, Estados Unidos en esa etapa era al menos cinco veces más poderoso que sus circunstanciales rivales, Rusia y China. Sin embargo, en la última década el escenario ha cambiado una vez más. El ascenso de China como nueva potencia ha puesto en cuestión la hegemonía estadounidense, llevando al mundo hacia una nueva configuración bipolar. De hecho, la brecha entre la primera y la segunda potencias se viene achicando y hoy es menor que en el mejor momento de la Unión Soviética. Nunca ha habido un país tan cerca de disputar el liderazgo de Estados Unidos como ahora.

Lo que las bombas atómicas hicieron en el siglo XX, seguramente lo haga la IA en el XXI. Las indudables aplicaciones militares de esta tecnología pueden, una vez más, resultar la clave para el balance geopolítico de las próximas décadas. Con una diferencia importante: esta vez buena parte del desarrollo tecnológico está en manos de corporaciones que, si bien son seguidas muy de cerca por los gobiernos, tienen sus propias agendas.

En este nuevo mapa mundial, no es sencillo estimar quién llegará primero. Pero si nos basamos en la cantidad de patentes relacionadas con la IA que presenta cada país, el dominio de China en los últimos años es abrumador. Entretanto, el gobierno de Estados Unidos presiona a Nvidia, la empresa más importante entre las que fabrican GPU, para que no venda a China los modelos más avanzados. Quizá el destino de esta pugna lo defina una pequeña isla, cinco veces menor en superficie que Uruguay: Taiwán juega un rol clave en el suministro de los equipos que sirven de base para la IA.

Es muy probable que, a partir de lo que pasó en la última posguerra, uno o ambos bandos hayan llegado a una sombría y peligrosa conclusión: la próxima vez que una potencia disponga de un arma que le dé una ventaja momentánea considerable respecto de sus rivales, habrá que intentar desarticular de inmediato los planes de la segunda para llegar al mismo punto. Por eso, antes de preocuparse por el escenario cinematográfico de una batalla de humanos contra máquinas, quizá nos encontremos con otro peligro más cercano: el uso de una IA como un arma sin precedentes en la eterna disputa de humanos contra humanos.

La gran muralla artificial

No es difícil sospechar el poder descomunal del uso militar de la inteligencia artificial. Visto esto, parece razonable tomar medidas que puedan delimitar su alcance. Pero otro gran desafío al que nos enfrentamos es que no hay en el mundo autoridades supranacionales que puedan imponer decisiones más allá de los intereses particulares de cada país. De modo que el futuro del mundo depende de la negociación entre potenciales adversarios individuales para solucionar problemas globalizados. Puede pensarse que esto no es muy distinto a lo que ha ocurrido en los últimos cien (o cinco mil) años, y es cierto. Pero el radio de destrucción de una bomba de inteligencia artificial es difícil de imaginar, y en escenarios tan volátiles, impredecibles y dispares estas conversaciones se vuelven particularmente inestables.

A fines de marzo de 2023, se presentó una carta abierta en la que más de mil expertos y empresarios de los más destacados en el desarrollo de la IA proponían un impasse de seis meses en el desarrollo de estos sistemas para evitar posibles resultados catastróficos. Entendida de manera literal, la carta peca de ingenuidad. Sería casi imposible lograr que empresas como OpenAI, Google o Meta aceptaran detener sus desarrollos de manera coordinada. Pero imaginemos por un instante que ese acuerdo fuera posible. ¿Cómo respondería el gobierno chino o sus empresas frente a ese compás de espera? Probablemente acelerando.

En algún sentido menos evidente, la IA ya se está usando como instrumento de la disputa geopolítica. En su documental El dilema de las redes, Tristan Harris sostiene que China utiliza activamente TikTok para impulsar agendas conflictivas y promover la polarización en Occidente. En China no se usa TikTok, sino una plataforma similar desarrollada por la misma empresa llamada Douyin. Presentan muchas similitudes, pero también algunas diferencias importantes que, según Harris, están pensadas explícitamente para “estupidizar” a la juventud occidental y fortalecer a la china. Mientras aquí se viralizan videos de gatitos y bailes, allí los influencers son físicos y astrónomos. En China sirven frutas y verduras y en Occidente, golosinas y papas fritas.

Cuando hace un poco más de una década nos enteramos de que China bloqueó el uso de Facebook y Google a muchos nos pareció una decisión autoritaria y antidemocrática. Sin embargo, ahora que TikTok tiene un auge enorme en Estados Unidos, muchos funcionarios y activistas de la mayor democracia occidental impulsan su prohibición, sobre la base de que es una herramienta de espionaje, que capta información personal sensible sobre la población. Nada muy distinto de lo que vienen haciendo hace muchos años las redes sociales y plataformas creadas allí, sólo que esta vez al servicio de los intereses y agenda de un rival geopolítico. Los que vivimos en países del Tercer Mundo generalmente nos sometemos mansamente a la entrega de nuestros datos tanto a un bando como al otro. No estamos invitados a este baile.

Dos meses después de la publicación de la carta que invita a ralentizar el avance de la IA, los ejecutivos principales de OpenAI publicaron un artículo en la página web de la empresa en el que llamaban a regular las posibles IA superinteligentes. Su propuesta incluía crear una agencia regulatoria internacional comparable a la que existe para la energía atómica, con capacidad de “inspeccionar y auditar sistemas, definir y controlar el cumplimiento de estándares de seguridad y restringir ciertos desarrollos” para proteger a la humanidad del riesgo de crear accidentalmente algo con el poder de destruirnos. Sus preocupaciones están justificadas y probablemente sus motivaciones sean genuinas. Pero es imposible no notar también que, si bien el tipo de regulaciones que impulsan los limita, también los deja dentro del espacio restringido donde se hará el desarrollo de la IA futura. Genera fuertes barreras de entrada para nuevos jugadores.

Existe un último pero importantísimo obstáculo a la regulación. La tecnología nuclear requería de enormes inversiones y acceso a materiales, como el uranio enriquecido. Eso hacía que el desarrollo quedara limitado a unos pocos gobiernos. En el caso de la IA, buena parte de la tecnología es de código abierto. No hay una restricción significativa sobre el software y el hardware para que un grupo de personas en cualquier lugar del mundo pueda realizar un hallazgo potencialmente revolucionario. Hoy en día, el cuello de botella, el verdadero elemento difícil y carísimo de construir, es el entrenamiento de los modelos.

Sobre la base de esta idea, Meta entregó a la comunidad científica su LLM similar a GPT, llamado LLaMA, con la idea de “democratizar el acceso a la IA”. Después de todo, el verdadero secreto no está tanto en la arquitectura de la red neuronal en sí, sino en los miles de millones de parámetros que determinan la fuerza de las conexiones y el sesgo de cada una de sus neuronas. Estos parámetros se aprenden en la interacción con enormes volúmenes de datos, diferentes grados de feedback humano y mecanismos adversariales o de autoaprendizaje. Sin conocer estos parámetros, que es lo más laborioso e intratable del proceso, no parecía peligroso que cualquiera pueda instalar un sistema como estos en su casa. Sin embargo, pocos días después del lanzamiento, se filtraron en internet los archivos con los parámetros de los modelos. A efectos prácticos, una IA muy poderosa es ahora completamente open source.

La reacción de los expertos está dividida. Mientras algunos opinan que se ha abierto la caja de Pandora y ahora cualquier actor puede hacer usos malignos, otros opinan que la transparencia total es la mejor manera de mitigar los riesgos. Tengan razón unos o los otros, este episodio puso otro freno a la regulación y control del uso de la IA. En algún momento, quizá, una única persona con ánimo de hacer mucho daño podría construir una bomba atómica informática en su casa.

Fragmento del libro Artificial. La nueva inteligencia y el contorno de lo humano, Mariano Sigman y Santiago Bilinkis, Debate, octubre de 2023.

Por Santiago Bilinkis y Mariano Sigman * Respectivamente: Economista. / Doctor en Neurociencia. / Le Monde diplomatique, edición Cono Sur