La alianza entre Microsoft y OpenAI nació en 2019 prometiendo acelerar la carrera por la inteligencia artificial, pero hoy parece tambalearse por un detalle casi filosófico: ¿qué diablos significa «inteligencia artificial general» (AGI) y quién decide en qué momento hemos llegado a ella?

El contrato que ambas compañías firmaron en 2022 permite a OpenAI cerrar el grifo a Microsoft de sus modelos más avanzados en cuanto su junta directiva declare que ese hito ha sido alcanzado. En ese contrato, en el que Microsoft comprometió 10,000 millones de dólares en el crecimiento de OpenAI, se estipula que la junta directiva de OpenAI, que sigue siendo una entidad sin ánimo de lucro, puede determinar que la compañía ha alcanzado la AGI.

En ese momento, Microsoft perdería el acceso a la tecnología más avanzada de OpenAI. Y si la junta directiva determina que la AGI «tiene la capacidad de generar» más de 130,000 millones de dólares en beneficios, Microsoft perdería sus derechos exclusivos para usar y vender cualquier tecnología de OpenAI – aunque Microsoft se reserva la posibilidad de impugnar la decisión de la junta y revisarla con expertos financieros externos. Dado que las conversaciones sobre la reestructuración con Microsoft llevan tiempo estancadas, OpenAI ha insinuado en los últimos meses que pronto podría declarar la AGI, mientras los directivos de Microsoft no coinciden en absoluto en que la empresa esté cerca de ese punto.

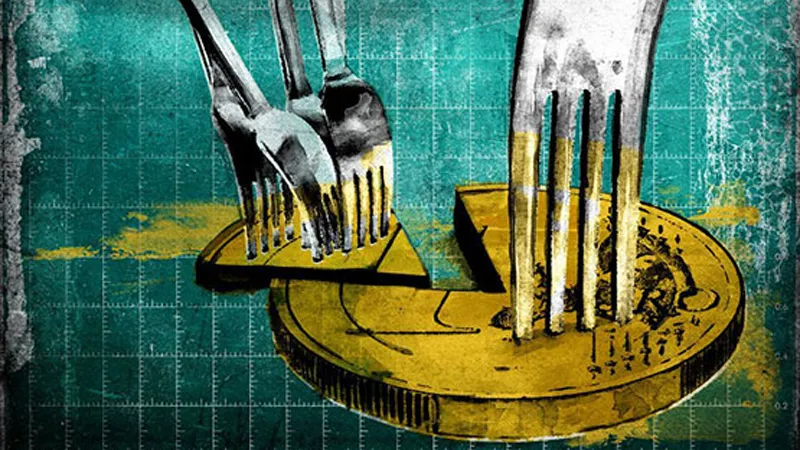

Esa «palanca de desconexión«, un verdadero botón rojo, amenaza con dejar a Microsoft sin el motor que ha impulsado buena parte de su narrativa de producto y de su subida en bolsa durante los últimos meses (un 17% sobre un precio que muchos ya consideraban caro), debida fundamentalmente al reconocimiento de su calidad de líder en el ámbito de la inteligencia artificial.

OpenAI define AGI como un «sistema altamente autónomo que supera a los humanos en la mayoría de los trabajos económicamente valiosos» y, desde su ensayo «Planning for AGI and beyond«, deja claro que ese momento podría estar a la vuelta de la esquina. Pero esa visión, prácticamente mesiánica, contrasta con la perspectiva de Satya Nadella: para el CEO de Microsoft, no habrá AGI hasta que veamos un salto de productividad que haga crecer el PIB mundial un 10%, y todo lo demás, dice, es puro «benchmark-hacking».

El desacuerdo no es solo semántico: quien controla la definición, controla también el calendario de pagos, la propiedad intelectual y la hoja de ruta de productos. De hecho, Microsoft insiste en renegociar la cláusula para no quedar expuesta a un corte súbito de suministro, mientras OpenAI ve en esa ambigüedad una salvaguarda ética o un arma de negociación, según se mire.

El problema, claro, es que nadie se pone de acuerdo sobre qué es «inteligencia artificial general». Desde el mundo académico, Shane Legg y Marcus Hutter llevan años defendiendo un criterio cuantificable: «la capacidad de un agente para lograr objetivos en una amplia variedad de entornos«, una definición menos poética, pero más mesurable, que sirve de base para múltiples métricas experimentales.

Los reguladores tampoco esperan a que los laboratorios se pongan de acuerdo. La recién aprobada Artificial Intelligence Act europea introduce la categoría de «modelos de IA de propósito general» y presume que, a partir de mil millones de parámetros (o 10²⁵ FLOPs de cómputo), entraremos en territorio de riesgo sistémico. No habla de AGI, pero señala un umbral técnico claro para activar unas supuestas obligaciones reforzadas de seguridad y transparencia, en el colmo absoluto de intentar regular lo que todavía no existe.

Tenemos, por tanto, tres visiones enfrentadas sobre lo que es AGI: una más mística (OpenAI), una más económica (Microsoft) y una más jurídico-técnica (Bruselas). El mercado observa todo esto completamente fascinado: si OpenAI aprieta el botón, Microsoft podría perder la ventaja competitiva que justifica su prima bursátil, mientras que si cede demasiado, está arriesgando su propia misión de «beneficio para toda la humanidad». Y mientras tanto, cada una de las definiciones moldea la inversión, la regulación y hasta la percepción social de lo que la inteligencia artificial puede hacer, debe hacer o se le permite hacer.

Discutir la línea que separa la inteligencia artificial actual de la inteligencia artificial general es disputar el futuro reparto de poder en el ecosistema tecnológico. El día que alguien proclame oficialmente el nacimiento de la AGI, no solo se activará una cláusula contractual, sino que se reordenará todo el tablero competitivo. Por eso la pregunta ya no es si llegaremos a la inteligencia artificial general, sino quién tendrá la autoridad y los incentivos para tratar de declararla. Y, sobre todo, qué haremos todos los demás cuando ese botón finalmente se pulse.

Nota: https://www.enriquedans.com/