Cuando Elon Musk lanzó Grokipedia, su enciclopedia generada por inteligencia artificial a partir de artículos de la Wikipedia con la intención de competir con esta, no se trataba simplemente de otro experimento de inteligencia artificial: se convirtió en un ejemplo paradigmático de todo lo que puede salir mal cuando el poder tecnológico, los prejuicios ideológicos y la automatización sin control convergen en las mismas manos.

Grokipedia copia extensas secciones de Wikipedia de manera prácticamente textual, mientras que reescribe y «reinterpreta» otras para reflejar la visión personal de Musk. Podría considerarse la antítesis de todo lo que hace que Wikipedia sea buena, útil y humana. Las modificaciones y añadidos de Grokipedia están dedicadas a editorializar agresivamente temas que van desde el cambio climático y la inmigración hasta (por supuesto) las empresas y la biografía del multimillonario.

El resultado es menos una enciclopedia que un espejo algorítmico de la ideología de una persona: un monumento digital a la autoconfianza tan desmedido que haría sonrojar a los mismísimos villanos de las películas de James Bond.

De la colaboración a la colonización

Wikipedia sigue siendo uno de los logros colectivos más extraordinarios de la humanidad: un repositorio global de conocimiento, impulsado por voluntarios y constantemente perfeccionado mediante el debate y el consenso. Sus imperfecciones son humanas, visibles y corregibles. Se puede ver quién editó qué, cuándo y por qué.

Grokipedia es su antítesis. Sustituye la deliberación por la automatización, la transparencia por la opacidad y el pluralismo por la personalidad. Sus «editores» son algoritmos entrenados bajo la dirección de Musk, que generan entradas reescritas que enfatizan sus narrativas favoritas y minimizan aquellas con las que discrepa. Es un ejemplo magistral de cómo NO crear una enciclopedia, una advertencia contra la confusión entre velocidad y sabiduría.

En Grokipedia, Musk ha hecho lo que la inteligencia artificial permite con demasiada facilidad: colonizar el conocimiento colectivo. Ha tomado un esfuerzo humano compartido, abierto, transparente y colaborativo, y lo ha automatizado hasta convertirlo en algo centralizado, controlado y sin rendición de cuentas. Y lo ha hecho cumpliendo con lo mínimo indispensable que exige la licencia copyleft de Wikipedia, en letra diminuta, en un lugar donde nadie puede verlo.

La caja negra se encuentra con el megáfono

Este no es el primer experimento de Musk con la manipulación de la verdad. Su red social, X, construida a partir de lo que quedó de Twitter, modifica habitualmente los algoritmos de visibilidad y priorización para favorecer las narrativas que se alinean con su visión del mundo. Ahora, Grokipedia extiende ese proyecto al ámbito del conocimiento estructurado. Utiliza el lenguaje de la autoridad, como entradas, citas y resúmenes, para dar a los sesgos una apariencia de objetividad.

Este es precisamente el peligro que advertí en un artículo anterior de Fast Company: el problema de la caja negra. Cuando los sistemas de inteligencia artificial son opacos y centralizados, ya no podemos discernir si un resultado refleja evidencia o intención. Con Grokipedia, Musk ha fusionado una caja negra con un megáfono, con todos los problemas que ello conlleva.

No es que la plataforma se equivoque en todos los hechos: es que no podemos saber qué hechos han sido filtrados, reponderados o reescritos, ni según qué criterios. O peor aún, podemos intuir que todo comienza con un conjunto de comandos que lo editorializan todo. La línea entre conocimiento y narrativa se desdibuja.

El problema de la automatización ideológica

El proyecto Grokipedia expone un problema más profundo en la trayectoria actual de la inteligencia artificial: la industrialización de la ideología.

La mayoría de la gente se preocupa por la desinformación generada por la inteligencia artificial como una propiedad emergente: algo que ocurre accidentalmente cuando los modelos generan alucinaciones o mezclan datos poco fiables. Grokipedia nos recuerda que la desinformación también puede ser intencional. Puede programarse, seleccionarse y sistematizarse deliberadamente.

Grokipedia se presenta como «una alternativa objetiva e imparcial a Wikipedia«. Este enfoque es en sí mismo un truco retórico: presentar el sesgo personal como neutralidad, y la neutralidad como sesgo. Es la táctica más antigua de la propaganda, solo que ahora automatizada a escala planetaria.

Este es el lado oscuro de la eficiencia de la inteligencia artificial generativa. Las mismas herramientas que pueden resumir artículos científicos o traducir textos antiguos también pueden reescribir la historia, ajustar el énfasis y pulir la ideología hasta que parezca equilibrada. El peligro no reside en que Grokipedia mienta, sino en que mienta con fluidez.

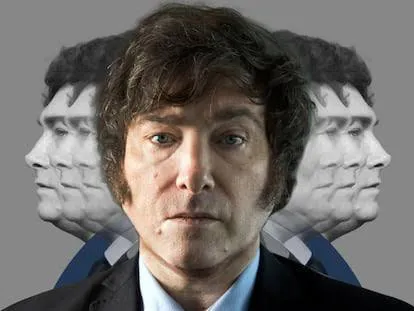

Musk, el villano de James Bond del conocimiento

Hay una razón por la que los proyectos de Musk evocan comparaciones con la ficción: la imagen que ha cultivado de disruptor, de visionario, de autoproclamado defensor de la verdad, ha evolucionado hasta convertirse en algo más parecido a la megalomanía de un villano de James Bond.

En las películas, el villano siempre busca controlar la energía, las comunicaciones o la información del mundo. Musk ahora incursiona en las tres. Construye cohetes, satélites, redes sociales y modelos de IA. Cada nuevo proyecto expande su control sobre una capa de la infraestructura global. Grokipedia es solo la última incorporación: la capa narrativa.

Si controlas la historia, controlas cómo la gente interpreta la realidad.

Lo que la IA nunca debería ser

Grokipedia es un ejemplo negativo perfecto de lo que la inteligencia artificial nunca debería ser: una máquina para amplificar las convicciones de una persona bajo la apariencia de verdad colectiva.

Resulta tentador descartar el proyecto como excéntrico o poco serio, pero sería un error. Grokipedia cristaliza un patrón que ya se está extendiendo por el panorama de la inteligencia artificial: muchos sistemas emergentes, ya sean de OpenAI, Meta o Anthropic, son propietarios, opacos y se gestionan de forma centralizada. La diferencia radica en que Musk ha explicitado sus sesgos, mientras que otros los mantienen ocultos tras una campaña de relaciones públicas corporativa.

Al apropiarse de un bien público como Wikipedia, Grokipedia demuestra lo que sucede cuando la gobernanza y la ética de la inteligencia artificial están ausentes: los recursos intelectuales creados por todos y para todos pueden ser fácilmente recolonizados por cualquiera con el poder suficiente para extraerlos, reempaquetarlos y automatizarlos.

El contraste con Wikipedia

El éxito de Wikipedia radica en algo de lo que la inteligencia artificial aún carece: la rendición de cuentas mediante la transparencia. Cualquiera puede consultar el historial de ediciones de una página, debatir sobre ella y restablecer el equilibrio mediante el consenso. Es un proceso complejo y a veces farragoso, pero democrático.

Los sistemas de inteligencia artificial, por el contrario, son autocráticos. Codifican las decisiones tomadas por sus creadores, pero presentan sus respuestas como verdades universales. Grokipedia lleva esta opacidad a su máxima expresión: una única versión incuestionable del conocimiento, generada por una máquina sin rendir cuentas.

Esto nos recuerda, de forma aleccionadora, que el problema de la inteligencia artificial no es su excesiva creatividad o poder, sino la facilidad con la que se puede abusar del poder sin supervisión.

Lecciones para la era de la IA

Grokipedia debería impulsar una reflexión profunda dentro de la comunidad de la inteligencia artificial y más allá. La lección no es prohibir la inteligencia artificial en la producción de conocimiento, sino que debe regirse como conocimiento, no como software.

Esto implica:

Transparencia sobre las fuentes de datos y los procesos editoriales.

Pluralismo: permitir múltiples voces y perspectivas en lugar de un control centralizado.

Responsabilidad, donde los resultados puedan ser auditados, cuestionados y corregidos.

Y sobre todo, humildad: reconocer que nadie, por brillante que sea, tiene derecho a definir qué es la verdad.

La inteligencia artificial tiene el potencial de ampliar la comprensión humana. Pero cuando se convierte en una herramienta de proyección ideológica, erosiona la propia idea de conocimiento.

La moraleja de la historia

Al final, Grokipedia no reemplazará a Wikipedia: más bien, se erigirá como un recordatorio de los albores de la era de la inteligencia artificial, el momento en que alguien confundió la capacidad computacional con la autoridad moral.

Elon Musk ha creado muchas cosas notables. Pero con Grokipedia, ha entrado en el terreno de la parodia distópica: la encarnación digital del villano de James Bond que, tras conquistar el espacio y las redes sociales, ahora pretende reescribir la propia enciclopedia.

El verdadero peligro de la inteligencia artificial no reside en la caja negra. Reside en la persona que la controla y decide qué podemos leer los demás en su interior.

Nota: https://www.enriquedans.com/